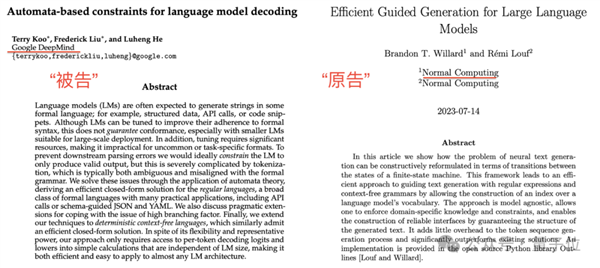

大模型圈再次曝光抄袭大瓜,这一次,“被告”还是著名的谷歌Depmind。

“原告”直接怒喷:他们只是把我们的技术报告洗了一遍!

具体情况如下:

谷歌Depmind一篇文章,顶流新生代会议CoLM 2024年的论文被挂了,瓜主直指抄袭了一年前挂在arxiv上的一项研究。开源的那种。

这两篇论文都讨论了一种规范模型文本生成结构的方法。

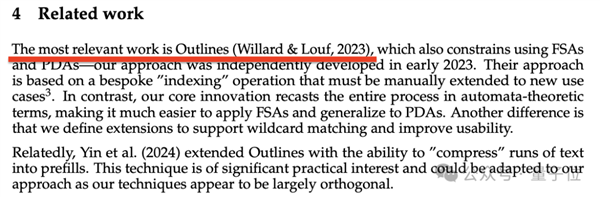

抓马的是,谷歌Deepmind这篇论文确实清晰地写着引用“原告”的论文。

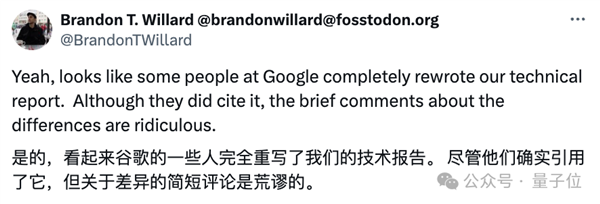

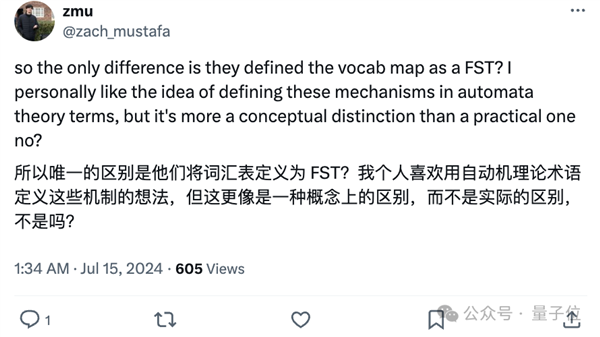

然而,鹅,即使标明了引用,“原告”两位论文作者Brandon T. Willard(布兰登)和R)emi Louf(雷米)仍坚称谷歌抄袭,并认为:

谷歌对两者差异的表达“简直荒谬”。

而且很多网友看完论文也慢慢打出一个问号:CoLM是怎么审稿的?

唯一的区别是改变了概念?

快速看一眼论文对比……

两篇论文的比较

先看两篇论文的摘要对比。

谷歌Depmind的论文说,tokenization给限制语言模型输出带来了麻烦。他们引入自动机理论来解决这些问题。核心是避免在每个解码步骤中通过所有逻辑值(logits)。

该方法只需访问每个代码的解码逻辑值,计算与语言模型的大小无关,高效易用于几乎所有的语言模型架构。

而“原告”说法大致如下:

通过构建语言模型词汇表上的索引,提出了一个有效的框架,大大提高了约束文本生成的效率。简单地说,它是通过索引来避免所有逻辑值的复制。

同样“不依赖于特定的模型”。

方向真的很不一样,我们继续看看更多的细节。

我们使用谷歌Geminini 1.5 Pro分别总结了两篇论文的主要内容,然后让Gemini比较两者的异同。

还没有评论,来说两句吧...